[ad_1]

Una nueva técnica de aprendizaje automático (una modalidad de inteligencia artificial) permite realizar predicciones con una precisión mucho mayor que mediante otras técnicas.

La nueva técnica es obra de un equipo de la Universidad Autónoma de Madrid (UAM) y el Instituto de Ciencias Matemáticas (ICMAT), ambas instituciones en España. Concretamente se trata de un nuevo método de aprendizaje automático probabilístico que permite obtener predicciones precisas, así como su probabilidad asociada. La nueva técnica podría ayudar a tomar decisiones en situaciones delicadas, como las asociadas al contexto médico o a la conducción autónoma.

El nuevo método presentado por el equipo de Simón Rodríguez Santana, del ICMAT, y Daniel Hernández Lobato, de la UAM, se denomina “minimización adversaria de alfa-divergencias” (AADM, por sus siglas en inglés), extiende y mejora la formulación existente dentro del aprendizaje automático probabilístico, y supone un importante avance en la expresividad y la flexibilidad de los métodos de aprendizaje automático probabilístico.

El empleo de la AADM permitirá una mayor adaptación de las técnicas de aprendizaje automático en situaciones complejas, es decir, en aquellas donde resulta necesaria una comprensión detallada de la situación y de las probabilidades de los resultados predichos.

Esto puede ser especialmente relevante en procesos de toma de decisiones en situaciones delicadas, como las que se pueden dar en el contexto médico o en la conducción autónoma, donde el aprendizaje automático probabilístico es empleado por las ventajas asociadas a esa información extra, ya que distintas decisiones pueden implicar consecuencias radicalmente diferentes.

![[Img #66250]](https://noticiasdelaciencia.com/upload/images/05_2022/7047_predicciones-mas-precisas-mediante-una-nueva-tecnica.jpg)

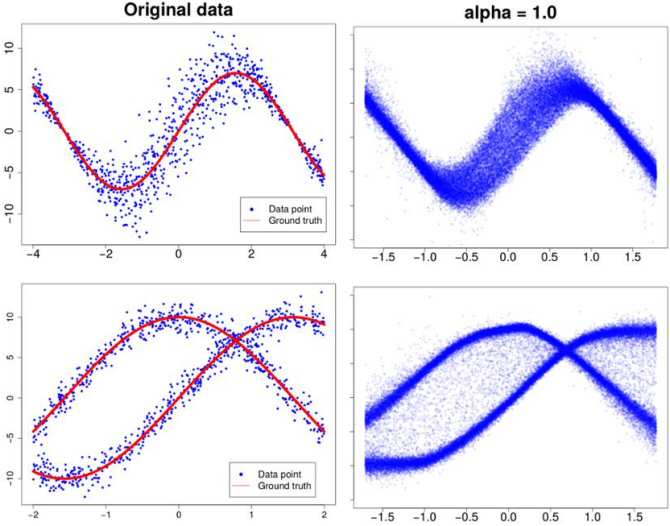

Los puntos azules de la izquierda representan los datos originales y el comportamiento subyacente (líneas rojas). A la derecha, están las predicciones, en este caso con α = 1.0. (Imágenes: UAM)

La perspectiva del aprendizaje automático probabilístico extiende las técnicas del casi ubicuo aprendizaje automático “usual” para obtener no solo predicciones, sino también las probabilidades asociadas a las mismas. Pero, ¿por qué es esto importante si las predicciones pueden ser buenas de por sí?

El motivo principal es que permite obtener más información, reflejando la incertidumbre de los algoritmos cuando se encuentran, por ejemplo, con situaciones complejas o incluso nunca antes vistas.

“Desde el punto de vista bayesiano, esto implica obtener distribuciones predictivas que informen sobre las distintas probabilidades para los resultados predichos. Sin embargo, esta no es una tarea sencilla y en muchas ocasiones se recurre a un compromiso, empleando simplificaciones que puedan facilitar el tratamiento pero que, en última instancia, pueden llegar a afectar negativamente a la calidad de las predicciones en sí”, señalan los investigadores.

El método AADM se basa en el uso dos sistemas que compiten entre sí para la optimización de un objetivo más general de lo usual en técnicas similares. Esto es posible mediante el uso de alfa-divergencias, una clase de medidas que permiten cuantificar las diferencias entre dos distribuciones de probabilidad.

“En concreto, las alfa-divergencias permiten controlar la expresividad de la distribución predictiva en función de la tarea y de los datos presentes. Permiten representar una generalización respecto a otras medidas de divergencia empleadas usualmente, las cuales pueden ser recuperadas simplemente fijando alfa a valores concretos”, detallan los investigadores.

AADM es capaz de proporcionar distribuciones más expresivas y representativas de lo que se era capaz hasta el momento con técnicas similares, captando detalles importantes incluso en situaciones con datos complejos, y todo por el mismo coste computacional.

“Esto permite que las predicciones sean más fieles y representativas de los datos originales, evitando padecer los problemas que conllevan algunas de las sobresimplificaciones presentes en otros métodos”, apuntan los investigadores.

“Además —agregan—, la flexibilidad asociada a las predicciones de AADM puede ser controlada seleccionando diferentes valores para alfa. En el trabajo demostramos mediante diversos experimentos que valores intermedios para este parámetro producen mejores resultados que los métodos previos”.

El equipo de investigación expone los detalles técnicos del método AADM en la revista académica Neurocomputing, bajo el título “Adversarial α-divergence minimization for Bayesian approximate inference”. (Fuente: UAM)

[ad_2]

Source link